Se oggi stai usando un software che suggerisce promozioni, confronta performance, analizza CV o assegna obiettivi con supporto AI, il tema non è più “capire se la norma ci riguarda”. Il tema è capire quanto sei esposto e chi, in azienda, deve muoversi adesso.

Per HR, People Operations, CEO e vendor HR tech, l’ai act cambia una cosa molto concreta: strumenti che fino a ieri sembravano normali componenti del processo manageriale possono entrare nell’area dei sistemi high-risk. Quando questo accade, non basta dire che c’è “sempre un umano nel loop”. Servono tracciabilità, documentazione, controllo dei dati, supervisione reale e ruoli chiari tra chi fornisce il sistema e chi lo usa.

Sintesi rapida

- Cos'è l'AI Act e Perché Riguarda la Tua Azienda

- La Piramide del Rischio dall'Inaccettabile al Minimo

- Obblighi Specifici per HR Tech e Performance Management

- Timeline di Adeguamento e Sanzioni Previste

- Guida Pratica alla Compliance in 6 Passi

- Oltre la Compliance l'AI Act come Opportunità di Mercato

- Domande Frequenti sull'AI Act per l'Ufficio HR

AI Act la Guida Operativa per Prepararsi

Il caso tipico è questo. L’azienda adotta un nuovo sistema di performance management con funzioni AI. Il manager riceve suggerimenti su bonus, priorità di sviluppo, valutazioni comparative o persino alert su chi non sta raggiungendo gli obiettivi. Il processo sembra più ordinato. Poi emerge la domanda che conta davvero: su quali dati si basa quella raccomandazione e come la difendi se viene contestata?

Nel lavoro HR, questa domanda ha un peso diverso rispetto ad altri ambiti. Un errore non incide solo su una dashboard. Incide su promozioni, percorsi di carriera, incentivi, esclusioni da shortlist, percezione di equità interna e rischio di discriminazione.

Regola pratica: se l’AI influenza una decisione che può cambiare il percorso professionale di una persona, trattala fin da subito come un tema di governance, non come una semplice feature software.

Molte aziende partono dal punto sbagliato. Cercano una risposta legale astratta, del tipo “il nostro tool è compliant?”. Nella pratica, la domanda utile è un’altra: quali funzioni usa il sistema, quali decisioni tocca, chi ne controlla l’output e quali prove puoi mostrare?

Per questo l’ai act va letto come un playbook operativo. Non serve solo al legale. Serve a HR, IT, procurement, direzione e ai fornitori di tecnologia. Nel contesto HR tech, le aree più sensibili sono quasi sempre queste:

- Recruiting e screening CV

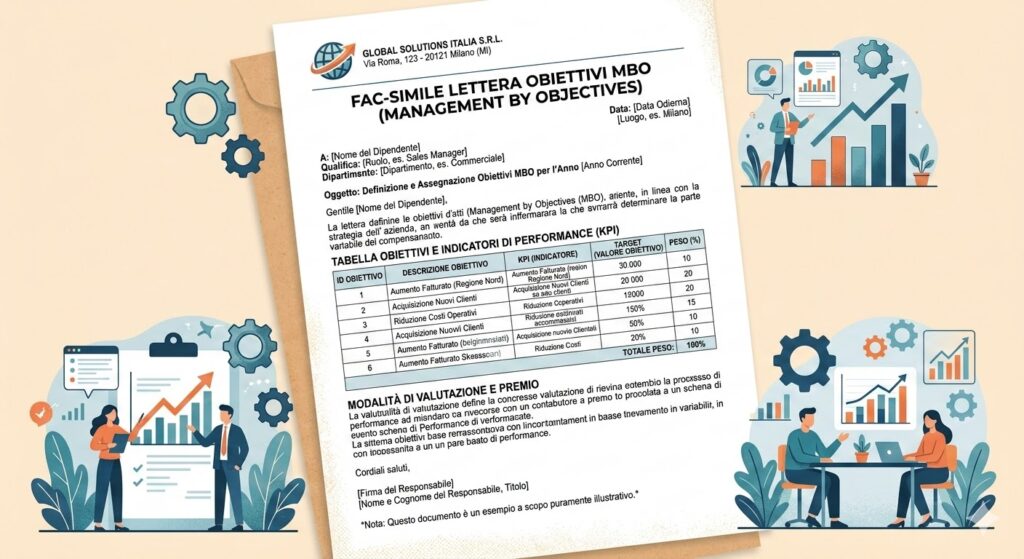

- Performance management con MBO, OKR e review

- Valutazioni 360 e scoring comportamentale

- Skill matrix e suggerimenti di sviluppo

- Monitoraggio produttività o engagement con logiche predittive

Chi guida persone e processi non ha bisogno di teoria generica. Ha bisogno di capire dove sta il rischio, cosa documentare, cosa bloccare e cosa invece può continuare a usare con buone regole.

Cos'è l'AI Act e Perché Riguarda la Tua Azienda

L’ai act è, in pratica, il GDPR degli algoritmi. Non disciplina l’innovazione in astratto. Regola l’uso dell’intelligenza artificiale quando può toccare sicurezza, diritti fondamentali, non discriminazione e trasparenza.

Il punto chiave per le aziende è semplice. Non riguarda solo chi “costruisce” modelli. Riguarda anche chi li integra nei processi quotidiani. Se usi una piattaforma per recruiting, appraisal o assegnazione obiettivi che sfrutta AI, sei dentro il perimetro operativo del regolamento.

Secondo la sintesi di Atlan sull’EU AI Act, il Regolamento (UE) 2024/1689 è entrato in vigore il 1 agosto 2024, è il primo quadro normativo completo sull’AI a livello mondiale, vieta 8 pratiche inaccettabili e prevede sanzioni fino a 35 milioni di euro o il 7% del fatturato annuo globale per le violazioni più gravi, oppure fino a 15 milioni di euro o il 3% per altre infrazioni.

Chi è coinvolto davvero

Nel lessico normativo si parla di fornitori, deployer, importatori e altri attori della filiera. Per un leader aziendale, la traduzione utile è questa:

- Il vendor deve progettare e mantenere il sistema secondo i requisiti applicabili.

- L’azienda che usa il sistema deve impiegarlo correttamente, con controlli, istruzioni, governance e verifiche coerenti con il rischio.

- HR e manager non possono limitarsi a usare il punteggio generato dall’algoritmo. Devono sapere quando l’output è affidabile e quando no.

Questo cambia il modo in cui va gestito l’acquisto di software HR. Non basta una demo efficace. Devi capire se il fornitore sa spiegare logica, limiti, fonti dati, supervisione umana e registri di controllo.

Per chi vuole allineare policy interne, processi e uso quotidiano degli strumenti, può essere utile anche una guida etica e pratica per l'uso legale dell'Intelligenza Artificiale, soprattutto per costruire una cultura di utilizzo responsabile oltre il puro adempimento.

Perché non basta dire che l’AI aiuta soltanto

Molti tool si presentano come “supporto decisionale”. In HR questa formula non ti mette automaticamente al sicuro. Se il sistema ordina candidati, evidenzia chi merita un premio, segnala anomalie comportamentali o suggerisce interventi che incidono sulla carriera, la sostanza conta più del marketing.

Per fissare bene il quadro, ecco un video utile:

Se non riesci a spiegare a un dipendente perché il sistema ha prodotto quel risultato, hai già individuato un problema di governance.

La Piramide del Rischio dall'Inaccettabile al Minimo

L’ai act non tratta tutti i sistemi allo stesso modo. Funziona con una logica a livelli. Per chi lavora in HR, questa classificazione è il filtro più utile per capire dove concentrare tempo, budget e controlli.

Rischio inaccettabile

Qui stanno le pratiche vietate. Non sono “tecnologie da gestire meglio”. Sono usi che il regolamento considera non ammissibili.

Nel lavoro e nelle funzioni people, il caso che molti sottovalutano è il ricorso a sistemi che entrano nell’area del riconoscimento delle emozioni nei luoghi di lavoro. Anche quando il prodotto viene venduto come strumento di wellbeing o engagement, il problema non è il nome commerciale. È l’effetto pratico del sistema.

In questa fascia la regola è una sola: se l’uso rientra tra le pratiche proibite, non si corregge con una policy. Si interrompe.

Rischio alto

Questa è la zona che riguarda davvero HR tech. Qui rientrano i sistemi che possono incidere in modo significativo su persone e diritti. In ambito aziendale, il rischio alto emerge spesso quando l’AI contribuisce a:

- Selezionare candidati

- Classificare performance

- Supportare promozioni o incentivi

- Valutare comportamenti o profili personali

- Determinare accesso a opportunità professionali

Per un HR director, il criterio pratico non è chiedersi se il tool “usa machine learning avanzato”. Il criterio è chiedersi se il sistema influisce su decisioni che un dipendente o candidato può contestare.

Un sistema può sembrare operativo e innocuo finché non lo colleghi a una decisione individuale. È lì che cambia categoria.

Rischio limitato

Qui trovi strumenti con obblighi di trasparenza più leggeri. Il caso più comune è il chatbot o il copilota che assiste l’utente, senza incidere direttamente su decisioni critiche.

Se, ad esempio, un assistente AI aiuta a redigere obiettivi o suggerisce contenuti di formazione, il punto non è vietarlo. Il punto è dichiarare in modo chiaro che l’utente sta interagendo con un sistema AI e definire limiti d’uso interni.

Rischio minimo o nullo

Alla base della piramide ci sono usi ordinari con impatto trascurabile. Non significa “nessuna regola in assoluto”. Significa che l’ai act non impone gli stessi obblighi delle categorie superiori.

Una lettura utile per HR

Una semplice matrice interna aiuta più di molte discussioni teoriche:

| Tipo di uso | Domanda da farsi | Segnale di rischio |

|---|---|---|

| Supporto operativo | L’AI propone solo bozze o contenuti? | Basso se non incide su persone |

| Supporto analitico | L’AI ordina, confronta o segnala individui? | Medio o alto |

| Decisione sensibile | L’output pesa su bonus, carriera, assunzione? | Alto |

| Pratica vietata | L’uso entra in aree proibite? | Da fermare |

Quasi tutti gli errori nascono da una cattiva classificazione iniziale. L’azienda compra un prodotto “smart”, lo mette in mano ai manager e solo dopo si accorge che sta usando l’AI per produrre effetti concreti sulla vita lavorativa delle persone.

Obblighi Specifici per HR Tech e Performance Management

L’area HR è tra le più esposte perché lavora ogni giorno con dati personali, giudizi comparativi, processi valutativi e decisioni che incidono direttamente sui lavoratori. Per questo, strumenti che gestiscono MBO, OKR, valutazioni 360, ranking, shortlist o scoring dei candidati possono entrare nella categoria high-risk.

Secondo la sintesi pubblicata su Artificial Intelligence Act EU, il 68% delle PMI italiane usa già AI per l’HR analytics, ma solo il 12% ha condotto valutazioni di rischio. La stessa fonte richiama anche il rischio di esclusione di gruppi sottorappresentati e cita casi in cui bisogni di salute di alcuni gruppi sono stati sottostimati del 46% a causa di dataset distorti. Per i leader HR il messaggio è netto: il problema non è teorico, e le sanzioni possono arrivare fino a 35 milioni di euro.

Dove vedo più errori operativi

Il primo errore è trattare il sistema come neutrale perché usa KPI. I KPI non eliminano il bias da soli. Se i dati storici riflettono pratiche sbilanciate, l’algoritmo può consolidarle.

Il secondo errore è confondere supervisione umana con approvazione finale. Se il manager clicca “approva” senza comprendere logica, limiti e qualità del dato, quella supervisione vale poco.

Il terzo errore è lasciare la valutazione del rischio solo al vendor. Chi compra e usa il sistema deve comunque capire come incide sui propri processi.

Cosa deve fare l’azienda che usa il tool

Per HR e management, la parte più concreta è questa checklist minima:

- Mappare gli usi reali. Non il nome del modulo, ma l’effetto nel processo. Screening CV, scoring performance, raccomandazioni su incentivi e simili.

- Individuare i momenti decisionali. Dove l’output AI modifica una scelta su persone, va alzato il livello di controllo.

- Verificare i dati in ingresso. Se arrivano da sistemi paghe, LMS, survey o review manageriali, va capito come vengono raccolti e se introducono distorsioni.

- Definire override e contestazione. Il dipendente deve poter contestare un esito. Il manager deve poter motivare uno scostamento dall’output.

- Rivedere il contratto con il fornitore. Va chiarito chi documenta cosa, chi monitora drift e anomalie, chi aggiorna il sistema e con quali evidenze.

Per chi sta valutando tecnologie di questo tipo, è utile confrontare i casi d’uso concreti dell’AI in HR, inclusi obiettivi, feedback e valutazioni, partendo da esempi come quelli raccolti qui: https://tryspark.co/ai-in-hr/

Cosa non funziona

Non funziona introdurre un modulo AI e rinviare la governance a “fase due”. Non funziona nemmeno spostare tutto sul DPO o sul legale. In HR la compliance è sempre interfunzionale.

Errore ricorrente: usare l’AI per ordinare persone, ma governarla come se stesse ordinando documenti.

Timeline di Adeguamento e Sanzioni Previste

Le scadenze dell’ai act sono già un calendario di lavoro. Se aspetti il momento in cui tutte le disposizioni ti toccano direttamente, arrivi tardi. Chi ha processi HR digitali dovrebbe usarle per pianificare audit, revisione vendor e priorità di budget.

La timeline più utile, in pratica, è questa.

| Scadenza | Obbligo | Azione Richiesta per le Aziende |

|---|---|---|

| 2 settembre 2024 | Avvio dei divieti sulle pratiche proibite | Verificare subito se esistono usi interni da fermare o rimuovere |

| Agosto 2025 | Obblighi per i modelli GPAI | Chiedere ai fornitori che integrano modelli general purpose come gestiscono documentazione e responsabilità |

| Agosto 2026 | Piena applicabilità del regolamento | Arrivare con governance, ruoli, policy, inventario AI e contratti già rivisti |

| Agosto 2027 | Obblighi per i sistemi high-risk | Completare la messa a terra operativa dei requisiti nei casi HR ad alto rischio |

Queste date derivano dalla sintesi dell’EU AI Act pubblicata da Atlan, che indica anche l’entrata in vigore del regolamento il 1 agosto 2024, la piena applicabilità da agosto 2026 e la fase dei sistemi high-risk da agosto 2027.

Come usare davvero la timeline

Un CFO legge la timeline in chiave budget. Un HR director la deve leggere in chiave processo. Le azioni immediate sono diverse:

- Se hai già strumenti AI in uso, fai una ricognizione contrattuale e funzionale adesso.

- Se stai acquistando un nuovo tool, inserisci requisiti di compliance in gara e in contratto.

- Se sviluppi internamente componenti AI, devi costruire governance e prova documentale prima di andare in esercizio.

Le sanzioni che contano

Le sanzioni più gravi, già richiamate sopra, arrivano fino a 35 milioni di euro o il 7% del fatturato annuo globale per violazioni delle pratiche proibite. Per altre infrazioni si arriva fino a 15 milioni di euro o il 3%. Per il board, questo è un tema di rischio enterprise. Per HR, è un tema di processo e accountability.

La lettura corretta non è “quanto è probabile un controllo”. La lettura corretta è “quanto siamo pronti a dimostrare che il sistema è stato scelto, configurato e usato con criterio”.

Guida Pratica alla Compliance in 6 Passi

La compliance efficace non parte dalla carta. Parte dall’inventario. Nelle aziende che si muovono bene, il percorso è operativo, breve e interfunzionale. Nelle aziende che si muovono male, si apre un tavolo legale e si rimanda la parte concreta.

L’Annesso IV richiede per i sistemi ad alto rischio una documentazione tecnica dettagliata che includa descrizione del sistema, design, architettura e schede dei dataset di training con provenienza, pulizia e labelling. La stessa sintesi segnala che automatizzare una living documentation può ridurre il rischio di non conformità del 30-50% (Artificial Intelligence Act Annex IV). In HR tech questo fa una differenza enorme, perché i sistemi cambiano spesso per configurazioni, workflow e dati collegati.

1. Censisci tutti i sistemi AI usati in HR

Non fermati alle piattaforme ufficiali. Cerca anche funzioni AI attivate dentro ATS, suite HCM, strumenti di survey, LMS e software di performance management.

Chiedi ai team:

- quali output automatici ricevono,

- se il sistema classifica persone,

- se suggerisce decisioni o priorità.

2. Classifica il rischio in base all’uso reale

Il nome del prodotto non basta. Conta l’uso nel processo. Un assistente che riassume feedback ha un profilo diverso da un sistema che propone chi promuovere.

Qui serve una decisione netta: quali casi d’uso possono rientrare nell’area high-risk?

3. Costruisci la documentazione viva

Questo è il passaggio che molte aziende saltano. Male. La documentazione non è un PDF da produrre a fine progetto. Va alimentata nel tempo.

Deve rispondere a domande concrete:

- qual è lo scopo previsto del sistema,

- quali dati usa,

- come sono stati selezionati o puliti,

- quali limiti noti esistono,

- come si aggiornano modelli, parametri e regole.

Per chi sta allineando AI governance e protezione dei dati, conviene far dialogare questo lavoro con le pratiche già adottate su sicurezza e trattamento dati, ad esempio in un impianto come quello descritto qui: https://tryspark.co/gdpr-sicurezza-dei-dati/

4. Imposta test e controlli periodici

I controlli utili non sono solo tecnici. Devono anche essere gestionali.

Verifica:

- coerenza degli output,

- scostamenti anomali tra gruppi,

- qualità dei dati in ingresso,

- cambiamenti dopo aggiornamenti o integrazioni.

Se il sistema cambia e la documentazione non cambia con lui, la compliance è solo apparente.

5. Definisci una supervisione umana vera

La supervisione efficace richiede ruoli precisi. Chi vede l’output deve sapere quando fidarsi, quando chiedere verifica, quando ignorarlo e come motivare la scelta.

Un manager senza istruzioni operative non è un controllo umano. È un passaggio di responsabilità.

6. Rivedi i contratti con i fornitori

Il contratto deve coprire almeno questi punti:

| Tema | Cosa chiarire |

|---|---|

| Documentazione | Chi la produce, chi la aggiorna, con quale frequenza |

| Dati | Origine, qualità, ruoli, limiti d’uso |

| Monitoraggio | Chi rileva anomalie, drift, incidenti e come li comunica |

| Supporto | Tempi e modalità per audit, richieste interne e verifiche |

Oltre la Compliance l'AI Act come Opportunità di Mercato

Chi tratta l’ai act solo come costo si mette in difesa. Chi lo usa per migliorare il prodotto e il processo interno costruisce fiducia. Nel mercato HR tech, questa differenza si vede subito.

Un sistema affidabile non è quello che promette più automazione. È quello che consente all’azienda di capire come lavora, dove può sbagliare e quali controlli esistono. Questo ha un impatto commerciale chiaro. Il buyer enterprise non cerca solo funzioni. Cerca fornitori che rendano sostenibile l’adozione.

Secondo la sintesi di Relyance AI sulla compliance al regolamento europeo, i sistemi ad alto rischio devono soddisfare 6 requisiti tecnici tra cui risk management continuo, data governance e solidità. La stessa fonte indica che l’aderenza a standard armonizzati può ridurre i tempi di valutazione della conformità fino al 40% e collega questo livello di affidabilità anche alla retention dei talenti (Relyance AI EU AI Act compliance).

Dove si crea vantaggio competitivo

Per un vendor HR tech, il vantaggio nasce quando certe capacità non vengono lasciate a processi manuali del cliente ma diventano parte del prodotto:

- Audit trail leggibile

- Spiegazioni degli output

- Controlli sui dati

- Workflow di escalation

- Registri di decisione e override

Per un’azienda che compra, invece, il vantaggio è interno. Le persone adottano più facilmente strumenti che percepiscono come chiari, contestabili e governati. Questo migliora la qualità dell’uso manageriale e riduce la diffidenza verso sistemi che toccano valutazione e crescita professionale.

Chi sta ripensando processi, stack applicativo e governance people può inserire il tema in un disegno più ampio di trasformazione HR, come in percorsi di https://tryspark.co/hr-digital-transformation/

Un buon progetto AI in HR non sostituisce il giudizio manageriale. Lo rende più disciplinato, più tracciabile e meno arbitrario.

Domande Frequenti sull'AI Act per l'Ufficio HR

Un software per obiettivi e valutazioni è sempre high-risk

Non sempre. Dipende dall’uso concreto. Se il sistema influenza decisioni rilevanti su carriera, incentivi, accesso a opportunità o valutazione comparativa delle persone, il livello di attenzione sale molto. La classificazione va fatta sul caso d’uso reale.

Se c’è l’approvazione finale del manager siamo tranquilli

No. La presenza del manager non basta da sola. Serve una supervisione capace di capire l’output, correggerlo, motivare la decisione e contestualizzare il dato.

Basta affidarsi alle garanzie del vendor

No. Le garanzie del fornitore sono importanti, ma chi usa il sistema in azienda deve governarne il funzionamento nel proprio contesto. Configurazioni, workflow, dati collegati e regole decisionali possono cambiare il profilo di rischio.

Da dove conviene partire in HR

Dall’inventario degli usi AI già attivi. Nella pratica, i punti più sensibili sono recruiting, performance review, scoring, survey interpretate con AI, skill assessment e suggerimenti automatici collegati a bonus o promozioni.

La compliance rallenta per forza l’adozione

Solo se viene affrontata tardi. Se viene impostata all’inizio, aiuta a scegliere meglio i fornitori, ridurre eccezioni, chiarire responsabilità e rendere il sistema difendibile davanti a dipendenti, sindacati, auditor e direzione.

Se stai rivedendo processi di performance management, MBO, OKR, feedback continui o valutazioni 360 con attenzione a governance e affidabilità, Spark è una piattaforma da valutare. Aiuta HR e manager a strutturare obiettivi, review, incentivi e competenze in un unico flusso operativo, con un approccio adatto alle aziende che vogliono digitalizzare senza perdere controllo sui processi che contano.